Irlandzki organ ds. ochrony prywatności sprawdzi, czy rozwój modelu sztucznej inteligencji przez Google jest zgodny z unijnym rozporządzeniem o ochronie danych.

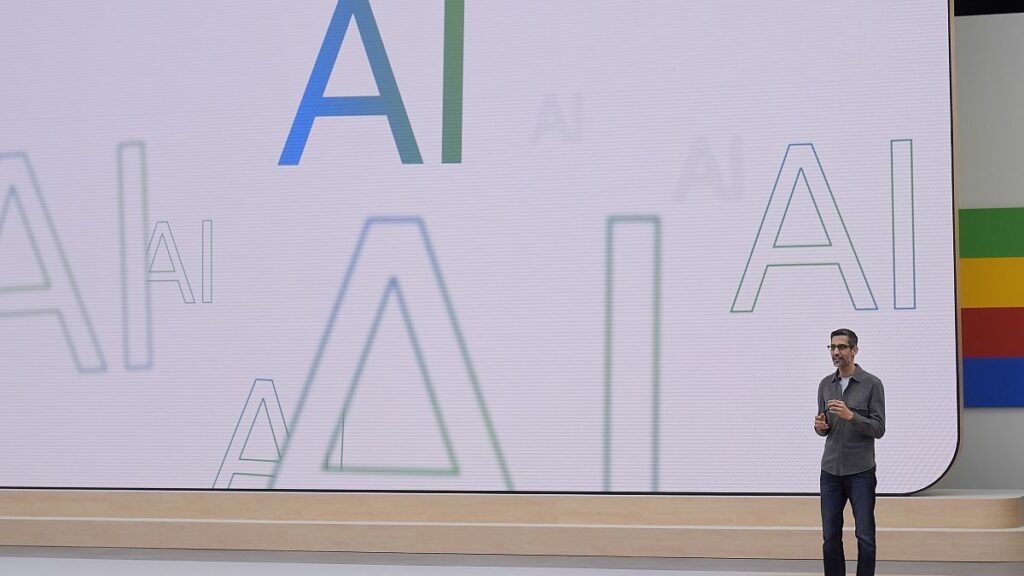

Irlandzka Komisja Ochrony Danych poinformowała dziś (12 września), że rozpoczęła transgraniczne ustawowe dochodzenie w sprawie Google, aby sprawdzić, czy praktyki tej firmy w zakresie sztucznej inteligencji są zgodne z unijnymi przepisami o ochronie danych.

Organ nadzorczy chce wiedzieć, czy gigant technologiczny przeprowadził ocenę zgodnie z unijnym ogólnym rozporządzeniem o ochronie danych (RODO) przed przetwarzaniem danych osobowych użytkowników z UE i EOG na potrzeby opracowania swojego podstawowego modelu sztucznej inteligencji, Pathways Language Model 2 – czytamy w oświadczeniu. .

„Ocena skutków dla ochrony danych (DPIA), tam gdzie jest to wymagane, ma kluczowe znaczenie dla zapewnienia odpowiedniego uwzględnienia i ochrony podstawowych praw i wolności osób fizycznych, w przypadku gdy przetwarzanie danych osobowych może wiązać się z wysokim ryzykiem” – irlandzki organ w dodatku,

Dochodzenie wpisuje się w „szersze wysiłki” agencji mające na celu uregulowanie przetwarzania danych osobowych użytkowników i obywateli UE przy opracowywaniu modeli sztucznej inteligencji.

W zeszłym miesiącu zbadano model AI Grok firmy X. Firma zajmująca się mediami społecznościowymi zmieniła w lipcu swoje ustawienia prywatności, więc użytkownicy z UE musieli zrezygnować z wykorzystywania przez xAI ich publicznych postów do szkolenia Groka, nowego modelu sztucznej inteligencji Elona Muska.

Władze irlandzkie zwróciły się do irlandzkiego Sądu Najwyższego z pilnym wnioskiem o wprowadzenie zmian, ponieważ uważały, że doszło do naruszenia praw do prywatności.

Postępowanie sądowe zakończyło się po tym, jak firma zgodziła się na trwałe zawieszenie gromadzenia danych osobowych użytkowników z UE w celu szkolenia sztucznej inteligencji.

Podobnie Meta wstrzymała w lipcu wdrażanie swojego modelu sztucznej inteligencji w Europie ze względu na „nieprzewidywalny charakter europejskiego otoczenia regulacyjnego” – stwierdziła firma.

Irlandzki organ ds. ochrony prywatności nawiązał współpracę z firmą Meta po złożeniu skarg przez austriacką grupę zajmującą się ochroną prywatności NOYB w związku z obawami dotyczącymi wykorzystania danych osobowych konsumentów.

![Vincent van Gogh, Kop van een vrouw (Gordina de Groot) (Head of a Woman [Gordina de Groot]), 1885.](https://tylkogliwice.pl/wp-content/uploads/2024/12/1734223076_Holenderskie-muzeum-kupuje-obraz-Van-Gogha-nazywany-„Mona-Lisa-Brabancji-150x150.jpg)